NVIDIA resmen Groq LPU’ları veri merkezlerine entegre ediyor

Düşük gecikmeli işlem pazarında dengeler hızla değişebilir.

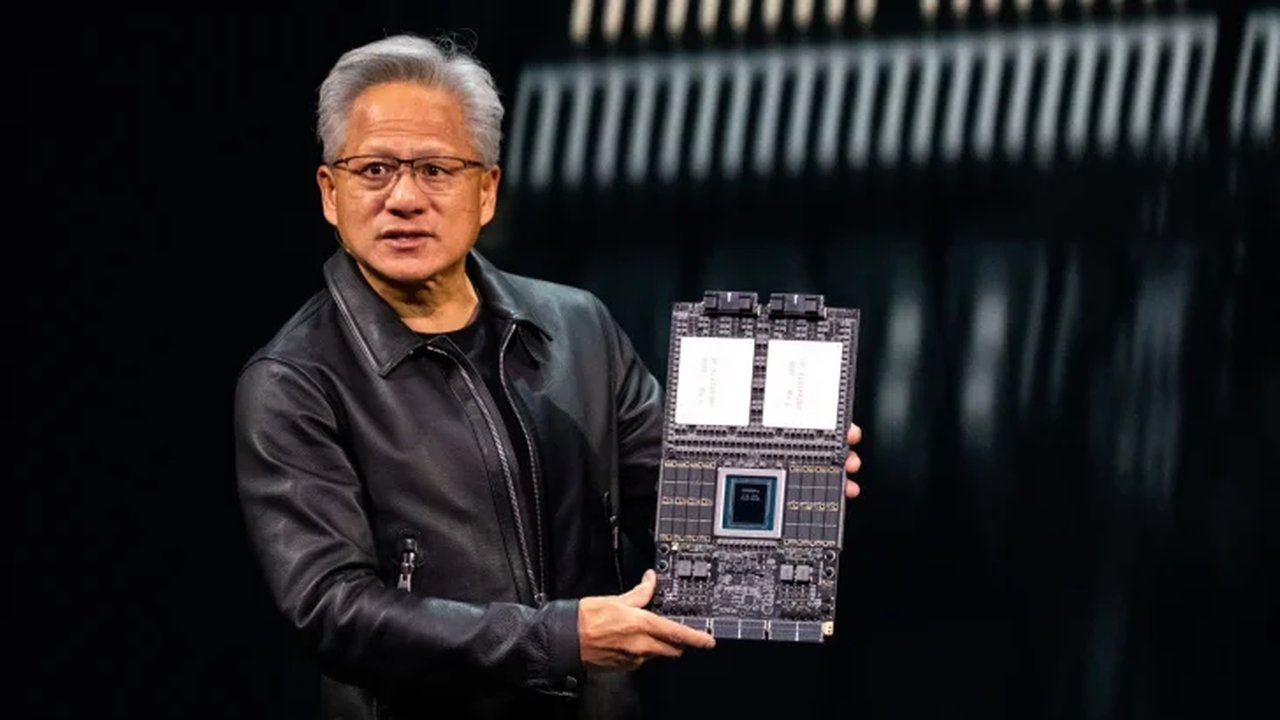

NVIDIA, Groq LPU birimlerini veri merkezi mimarisine entegre etme planlarıyla sektörde tartışma başlattı. Şirket CEO’su Jensen Huang, Q4 2026 kazanç çağrısında Groq LPU birimlerinin gecikme-duyarlı iş yüklerinde nasıl bir rol oynayacağına dair önemli ipuçları verdi.

Groq LPU birimleri neden önemli?

NVIDIA, Groq satın almasını gecikme-duyarlı iş yüklerine yönelik bir hamle olarak konumlandırıyor. Bununla birlikte, özellikle inference (çıkarım) aşamasında düşük gecikme sağlayacak çözücüler (decoder) ve hızlı KV cache yönetimi kritik hale geldi. Öte yandan, agentik AI uygulamaları ultra-hızlı yanıtlar gerektirdiğinden LPU’lar rekabet avantajı yaratabilir.

NVIDIA Groq anlaşmasında neler var?

NVIDIA bu yıl agresif satın almalar yaptı ve Groq ile gerçekleştirdiği anlaşma lisanslama içermiyor ve 20 milyar dolara kadar değer biçiliyor. Sonuç olarak, şirket bu büyüklükteki yatırımı Team Green’in en büyük hamlesi olarak görüyor. Duyuruyu NVIDIA Noel Arifesi’nde yaptı ve ardından CEO Jensen Huang söz konusu entegrasyonun mimariyi nasıl genişleteceğine dair bağlam verdi.

Groq ve low latency decoder (düşük gecikmeli çözücü) hakkında nasıl düşündüğümüze gelince, GTC’de sizinle paylaşmak istediğim bazı harika fikirlerim var.

Ve bu nedenle Groq ile yapacağımız şey şu: GTC’ye gelince göreceksiniz, ama yapacağımız şey Groq’u bir accelerator (hızlandırıcı) olarak kullanarak mimarimizi genişletmek olacak; tıpkı Mellanox ile NVIDIA’nın mimarisini genişlettiğimiz şekilde.

— NVIDIA CEO’su Jensen Huang

LPUs’u NVIDIA mimarisine nasıl entegre edecekler?

Jensen Huang, Groq’un rolünü Mellanox satın alımıyla kıyasladı ve Mellanox’un NVIDIA’nın networking (ağ) sorunlarını çözdüğünü hatırlattı. Buna göre, NVIDIA Groq ile mimarisini “rack-scale” düzeyinde genişletebilir.

Öte yandan, LPUs’un entegrasyonuna dair iki ana teori öne çıkıyor: raf-ölçekli hibrit düğümler veya Feynman GPU’lar içinde on-die birimler. Bununla birlikte, şu an için rack-scale yaklaşımı daha olası görünüyor.

Entegrasyon senaryoları

- Rack-scale: Birden fazla LPU’yu birleşik bir interconnect üzerinden bağlayarak hibrit compute düğümleri oluşturma.

- On-die entegrasyon: LPUs’un hybrid bonding ile Feynman GPU’lara doğrudan yerleştirilmesi.

- NVLink Fusion: LPU-to-GPU iletişimi için KV cache offload yönetimi ve yüksek bant genişliği desteği sağlama.

LPUs performansı ve teknik detaylar nasıl?

NVIDIA, decode ve prefill aşamalarında farklı optimizasyonlar uyguluyor; Rubin CPX ile prefill aşamalarını attention-acceleration engine’leri ve NVFP4 compute ile kapattı. Buna karşın decode aşamalarında Groq LPU’ların on-die SRAM ile onlarca terabayt/saniye iç bant genişliği sunması bekleniyor.

Öte yandan, SRAM yaklaşımını Cerebras WSE-3 ve Microsoft Maia 300 gibi örneklerde gördük. Sonuç olarak, LPUs’un düşük gecikme ve yüksek bant genişliği ihtiyaçlarını hedeflemesi bekleniyor.

Beklenen duyurular ve piyasa etkisi nedir?

GF Securities (via Jukan) NVIDIA’nın bu yılki GTC’de tek bir ünite içinde 256 LPU barındıran bir “LPX rack” duyurabileceğine inanıyor. Buna göre, LPU-to-LPU bağlantıları için NVIDIA’nın plesiosynchronous chip-to-chip protokolünü kullanma olasılığı konuşuluyor.

Bununla birlikte, NVIDIA’nın LPU planları Mellanox’un networking alanındaki etkisine benzer bir rol oynayarak şirkete gecikme-duyarlı iş yüklerinde erken avantaj sağlayabilir. Jensen çağrı sırasında compute ve gelirin artık 1:1 oranında büyüdüğünü, bunun da AI uygulama katmanının daha agresif evrimiyle bağlantılı olduğunu belirtti.

GF Securities, (via Jukan) NVIDIA’nın bu yılki GTC’de tek bir ünite içinde 256 LPU birimi barındıran bir “LPX rack” duyurabileceğine inanıyor. Onların bilgileri ışığında, LPU-to-LPU bağlantıları için NVIDIA’nın yerel plesiosynchronous chip-to-chip protocol (plesiosenkron çip-çip protokolü) kullanacağını düşünüyoruz. LPU-to-GPU için ise prefill aşamasında GPU’lardan gelen büyük KV cache offload (KV önbellek boşaltması) ile başa çıkmak üzere NVLink Fusion’ın dahil edildiğini görebiliriz. Diğer incelenen seçenek, LPUs’un hybrid bonding (hibrit bağlama) yoluyla Feynman GPUs içinde on-die birimler olarak yer alması, ancak şimdilik rack-scale seçeneği çok daha muhtemel görünüyor.

Ana fikir, Groq’un LPU birimlerinin networking alanında Mellanox’un oynadığı role benzer bir etki yaratacağı; bu hibrit mimari NVIDIA’ya gecikme-duyarlı iş yüklerinde erken avantaj sağlayacak. NVIDIA’nın LPU planlarını bu yılki GTC’de resmen duyurmasını bekliyoruz.

Sonuç olarak, Groq LPU birimleri NVIDIA’nın inference ve düşük gecikme gerektiren AI iş yüklerindeki konumunu güçlendirme potansiyeli taşıyor. Okuyucuların görüşleri önemlidir; yorumlarda bu entegrasyonun veri merkezi stratejilerine etkisini tartışın.